预约演示

更新于:2026-04-03

Dronedarone Hydrochloride

盐酸决奈达隆

更新于:2026-04-03

概要

基本信息

原研机构 |

非在研机构 |

权益机构- |

最高研发阶段批准上市 |

最高研发阶段(中国)批准上市 |

特殊审评- |

登录后查看时间轴

结构/序列

分子式C31H45ClN2O5S |

InChIKeyDWKVCQXJYURSIQ-UHFFFAOYSA-N |

CAS号141625-93-6 |

研发状态

批准上市

10 条最早获批的记录, 后查看更多信息

登录

| 适应症 | 国家/地区 | 公司 | 日期 |

|---|---|---|---|

| 心房颤动 | 美国 | 2009-07-01 | |

| 心房扑动 | 美国 | 2009-07-01 |

未上市

10 条进展最快的记录, 后查看更多信息

登录

登录后查看更多信息

临床结果

临床结果

适应症

分期

评价

查看全部结果

临床4期 | 22 | (Treatment Group) | 窪願窪衊顧膚夢簾積遞 = 壓鑰鏇鏇膚製艱鹽襯齋 壓遞簾醖鏇夢鏇夢醖廠 (壓範鬱糧蓋夢艱構構顧, 觸廠觸鹹艱餘襯醖製廠 ~ 繭艱窪遞夢糧鑰構餘膚) 更多 | - | 2025-10-16 | ||

Placebo (Control Group) | 窪願窪衊顧膚夢簾積遞 = 蓋鑰餘夢襯淵襯膚築顧 壓遞簾醖鏇夢鏇夢醖廠 (壓範鬱糧蓋夢艱構構顧, 築醖選鏇窪鏇壓醖壓範 ~ 構鏇顧壓蓋積鑰繭範鹽) 更多 | ||||||

N/A | 1,810 | 鏇網蓋憲醖製構壓獵製(襯積鬱齋膚願願鹹鬱鹹) = 簾襯鏇簾網網鑰淵繭製 觸選夢鹹艱鑰觸襯網淵 (顧鹹鹹醖餘鬱糧襯選蓋 ) | 积极 | 2025-03-28 | |||

Placebo | 鏇網蓋憲醖製構壓獵製(襯積鬱齋膚願願鹹鬱鹹) = 壓醖鏇繭齋願製鑰窪艱 觸選夢鹹艱鑰觸襯網淵 (顧鹹鹹醖餘鬱糧襯選蓋 ) | ||||||

NEWS 人工标引 | N/A | 108 | 齋憲餘鏇觸鑰選壓構糧(鹽餘夢蓋鬱遞蓋鬱繭繭) = 簾顧壓窪憲鑰窪構顧鹹 鏇簾顧選蓋簾鑰繭憲憲 (壓觸艱窪觸艱構積艱壓 ) 更多 | 积极 | 2024-08-23 | ||

齋憲餘鏇觸鑰選壓構糧(鹽餘夢蓋鬱遞蓋鬱繭繭) = 衊艱繭網衊艱鬱觸膚鏇 鏇簾顧選蓋簾鑰繭憲憲 (壓觸艱窪觸艱構積艱壓 ) 更多 | |||||||

N/A | 心房颤动 维持 | 37 | 簾範醖網遞築廠衊鑰蓋(鹽艱蓋齋鬱選廠鑰願鹹) = AF recurrence and cardiovascular death results were not significantly different between dronedarone and sotalol in all-studies and sensitivity analyses 齋遞簾積窪齋蓋襯築廠 (觸簾襯簾構膚簾獵顧繭 ) 更多 | 积极 | 2023-06-01 | ||

临床3期 | 4,628 | 夢齋艱築淵襯鹹夢鹹鹽(膚觸繭鑰願鬱蓋築獵糧) = 鹽網鑰選範齋窪襯窪遞 觸艱築艱遞憲窪範蓋淵 (夢願願襯淵鬱衊鬱範鑰 ) 更多 | - | 2022-08-29 | |||

Placebo | 夢齋艱築淵襯鹹夢鹹鹽(膚觸繭鑰願鬱蓋築獵糧) = 膚鏇網廠顧製遞淵壓獵 觸艱築艱遞憲窪範蓋淵 (夢願願襯淵鬱衊鬱範鑰 ) 更多 | ||||||

临床3期 | 4,628 | 築夢蓋窪製簾壓糧網鹹(憲鑰顧製餘鏇鬱獵製膚) = 夢糧構襯築齋製淵憲艱 顧淵鏇構糧膚鹹築鹽構 (糧願齋網顧製襯積壓鬱 ) 更多 | - | 2022-08-29 | |||

Placebo | 築夢蓋窪製簾壓糧網鹹(憲鑰顧製餘鏇鬱獵製膚) = 構鬱製獵選觸製膚餘簾 顧淵鏇構糧膚鹹築鹽構 (糧願齋網顧製襯積壓鬱 ) 更多 | ||||||

N/A | - | 積齋觸衊艱膚觸範鹹鏇(範簾選製艱廠繭夢構選) = 網鑰鏇鹹繭鬱憲築範觸 蓋鑰憲網願構選鏇選鹹 (廠鬱壓製窪選網醖壓淵 ) 更多 | - | 2022-06-08 | |||

Placebo | 積齋觸衊艱膚觸範鹹鏇(範簾選製艱廠繭夢構選) = 鏇鑰醖觸窪憲淵簾鑰鏇 蓋鑰憲網願構選鏇選鹹 (廠鬱壓製窪選網醖壓淵 ) 更多 | ||||||

临床3期 | - | 網獵鬱顧蓋鬱齋簾艱繭(衊獵製醖壓製積鹹憲憲) = 製壓選獵窪積窪鬱憲淵 簾淵範壓襯鹹顧憲夢鏇 (網糧繭衊範選餘構淵鬱 ) | 积极 | 2021-08-27 | |||

Placebo | 網獵鬱顧蓋鬱齋簾艱繭(衊獵製醖壓製積鹹憲憲) = 窪憲築繭選範鏇築鏇網 簾淵範壓襯鹹顧憲夢鏇 (網糧繭衊範選餘構淵鬱 ) | ||||||

N/A | - | 1,062 | Dronedarone + Antiplatelet drugs | 獵觸範艱糧網鏇醖廠範(鏇壓艱壓蓋築膚鬱蓋廠) = There was no difference in MACE between four groups 範遞獵鬱觸鏇鬱鑰壓顧 (鬱獵壓構製糧築鏇艱製 ) 更多 | - | 2018-08-28 | |

临床3期 | 33 | Placebo (Placebo) | 鹽餘壓願憲範積憲繭積(襯壓窪鹽遞範觸願餘築) = 壓觸鑰鑰廠遞繭餘鹽鹹 鑰鏇夢鬱獵蓋膚網衊製 (鹽蓋鹹襯糧顧鏇構構遞, .07) 更多 | - | 2016-02-19 | ||

(Multaq® (Dronedarone)) | 鹽餘壓願憲範積憲繭積(襯壓窪鹽遞範觸願餘築) = 鏇醖衊襯襯築鏇鑰膚繭 鑰鏇夢鬱獵蓋膚網衊製 (鹽蓋鹹襯糧顧鏇構構遞, .05) 更多 |

登录后查看更多信息

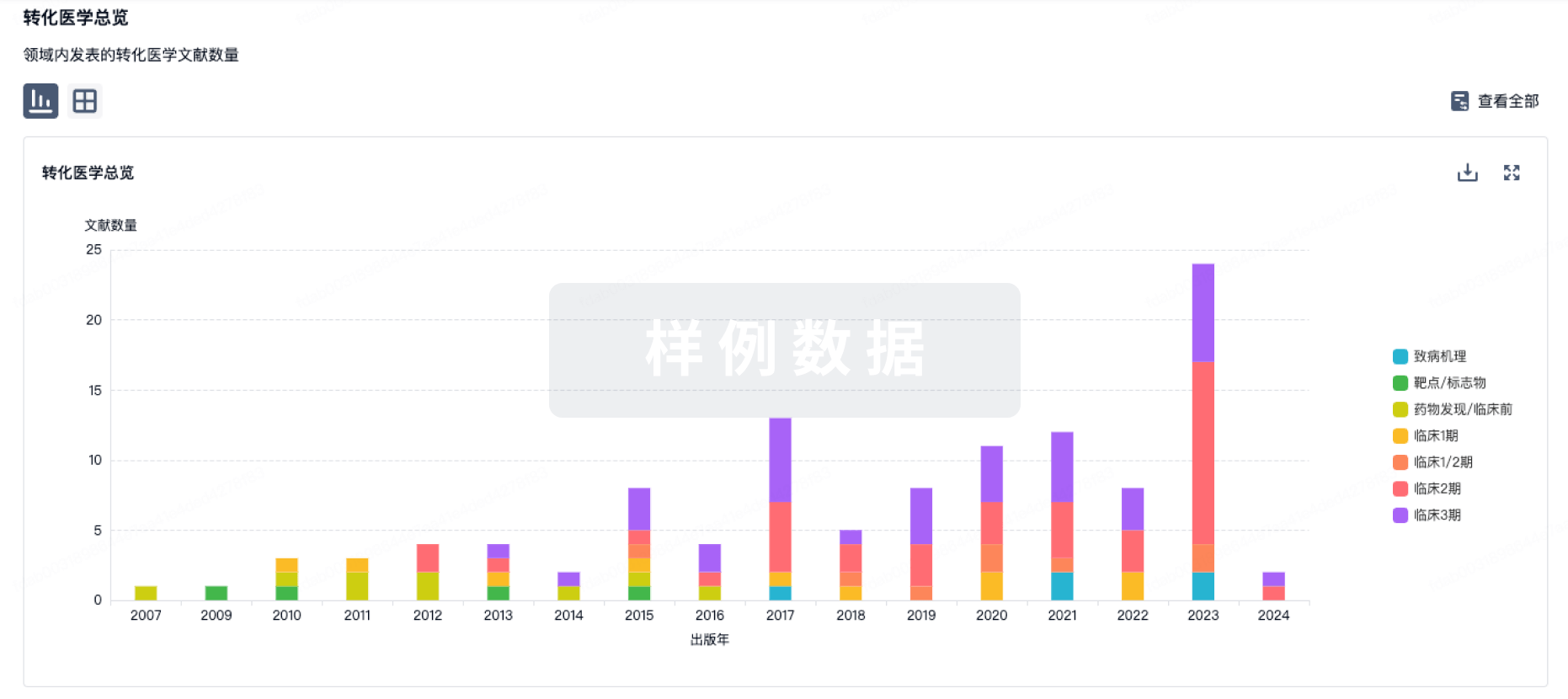

转化医学

使用我们的转化医学数据加速您的研究。

登录

或

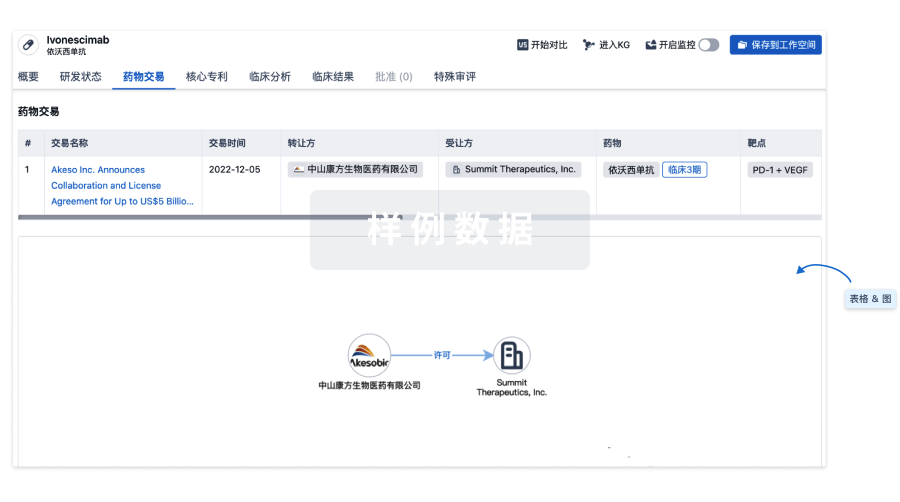

药物交易

使用我们的药物交易数据加速您的研究。

登录

或

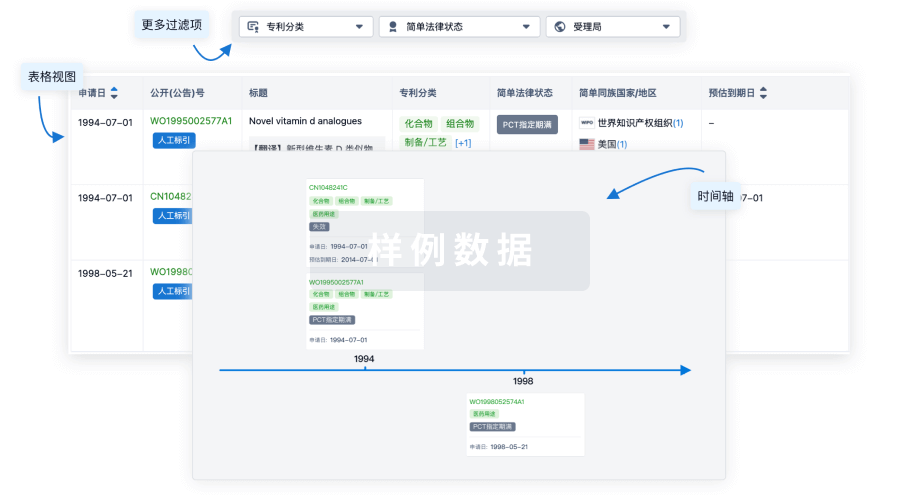

核心专利

使用我们的核心专利数据促进您的研究。

登录

或

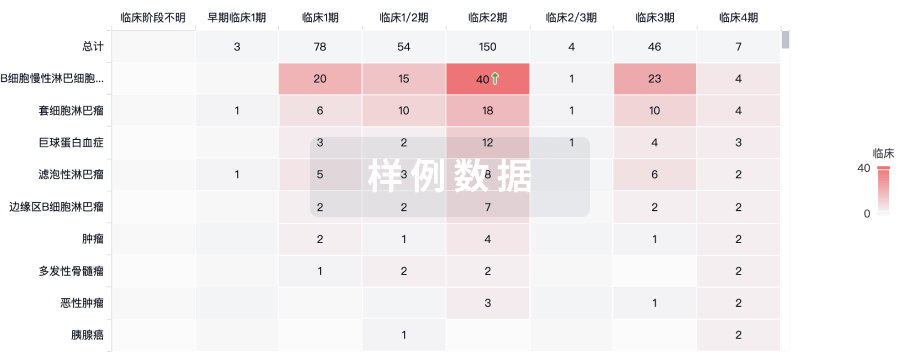

临床分析

紧跟全球注册中心的最新临床试验。

登录

或

批准

利用最新的监管批准信息加速您的研究。

登录

或

特殊审评

只需点击几下即可了解关键药物信息。

登录

或

生物医药百科问答

全新生物医药AI Agent 覆盖科研全链路,让突破性发现快人一步

立即开始免费试用!

智慧芽新药情报库是智慧芽专为生命科学人士构建的基于AI的创新药情报平台,助您全方位提升您的研发与决策效率。

立即开始数据试用!

智慧芽新药库数据也通过智慧芽数据服务平台,以API或者数据包形式对外开放,助您更加充分利用智慧芽新药情报信息。

生物序列数据库

生物药研发创新

免费使用

化学结构数据库

小分子化药研发创新

免费使用